RFusion-robot kan gericht objecten lokaliseren en oppakken

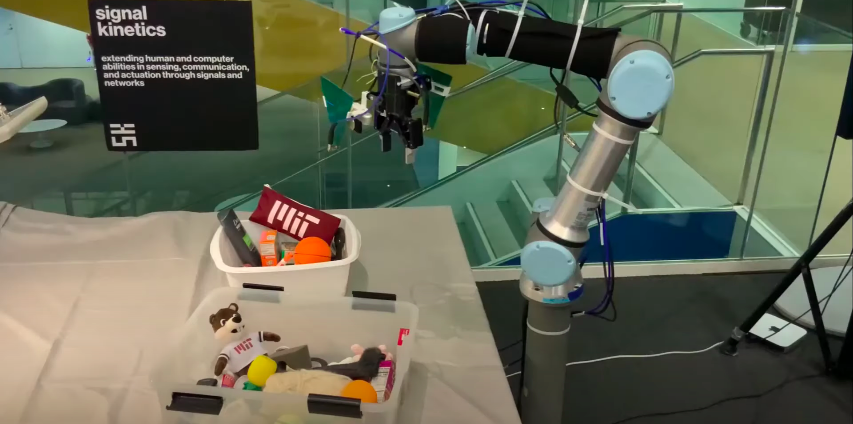

Een nieuwe robot genaamd RFusion kan gericht objecten lokaliseren en oppakken. Het gaat hierbij om objecten die direct in het zicht liggen, maar ook om objecten die volledig bedekt zijn onder bijvoorbeeld andere objecten. De robot is ontwikkeld door Tara Boroushaki, Isaac Perper, Mergen Nachin, Alberto Rodriguez en Fadel Adib van het Massachusetts Institute of Technology (MIT).

Al langer bestaan robotarmen die autonoom objecten kunnen lokaliseren en oppakken. Vaak maken deze systemen gebruik van camera’s, die in veel gevallen goede prestaties leveren. “Indien het gewenste object echter volledig bedekt is, kunnen robotsystemen die vertrouwen op camera’s het niet waarnemen. Zij vallen dan terug op een tijdrovend zoekproces”, schrijven de onderzoekers in hun paper.

Het gebruik van radiofrequenties (RF) kan uitkomst bieden. Aangezien RF-golven door objecten kunnen bewegen, kan RF helpen bij het lokaliseren van objecten onder bijvoorbeeld een stapel andere objecten. Bestaande systemen die RF inzetten voor het oppakken van objecten maken hierbij echter vaak beperkende aannames over het object en hun omgeving. Dit beperkt volgens de onderzoekers in de praktijk hun bruikbaarheid.

Technieken combineren

RFusion combineert daarom verschillende technieken. De robot bestaat uit een robotarm die op zijn grijper is voorzien van zowel een camera als een antenne. Beide worden ingezet voor het lokaliseren van specifieke objecten. Hierbij maakt RFusion gebruik van een tweetal nieuwe technieken: RF-visual sensing en RF-visual reinforcement learning. “We presenteren RFusion, een volledig geïntegreerde robot die het praktisch en efficiënt oppakken van objecten in direct zicht, buiten direct zicht en volledig bedekte omstandigheden mogelijk maakt”, schrijven de onderzoekers.

Het systeem werkt met behulp van standaard RFID-tags, die op objecten worden aangebracht. Met behulp van deze RFID-tags kan de robot objecten opsporen. In eerste instantie maakt de robot hierbij gebruik van de antenne op zijn grijper, waarmee RFusion met de RFID-tag communiceert. De reactie van deze tag wordt geanalyseerd. Zo brengt de robot in kaart hoe lang het signaal nodig heeft om van de antenne naar de tag en terug te reizen.

Deze informatie is echter niet voldoende voor het effectieve wijze lokaliseren van een object. De robot combineert de meetgegevens daarom met aanvullende RF- en visuele informatie. Deze combinatie stelt RFusion in staat tot het lokaliseren van een object, hiernaar toe bewegen en oppakken van het gewenste object.

Dense RF-Visual Geometric Fusion

Dit proces vindt gefaseerd in drie stappen plaats. De eerste stap noemen de onderzoekers ‘Dense RF-Visual Geometric Fusion’. RFusion meet hierbij met behulp van zijn antenne de afstand naar een object. Deze informatie combineert het met visuele data verzameld met behulp van zijn ingebouwde camera. De combinatie leidt tot een lijst met potentiële locaties waar het gezochte object zich mogelijk bevindt.

RF-Visual Reinforcement Learning

De tweede fase is ‘RF-Visual Reinforcement Learning’. In deze fase brengt de robot zijn grijper naar een nieuwe locatie, waar het nieuwe RF- en visuele gegevens verzamelt. De onderzoekers zetten hierbij een zogeheten reinforcement learning network in. Reinforcement learning is onderdeel van machine learning. Hierbij leren agents van een AI-netwerk zelfstandig actie te ondernemen voor het maximaliseren van hun resultaten.

Dit netwerk analyseert eerdere RF- en visuele metingen voor het bepalen van de optimale volgende locatie voor zijn grijper. En daarmee die van zijn antenne en camera. Dankzij deze metingen krijgt RFusion een steeds beter beeld van de geschatte locatie van het gezochte object. De robot herhaalt het proces totdat hierover voldoende zekerheid bestaat.

RF-Visual Grasping

Zodra de robot voldoende zeker is van de locatie van het gezochte object, gaat het proces door naar de volgende fase. In deze fase pakt de robotarm het object op. Zodra het object is vastgepakt controleert de robot met behulp van zijn antenne via additionele RFID-metingen of het gewenste object inderdaad succesvol is opgepakt. Indien dit niet het geval is wordt het proces herhaalt. Net zo lang tot de robot het object in zijn grijper detecteert.

Nauwkeurigheid

Een prototype van RFusion is door de onderzoekers in praktijksituaties getest. De onderzoekers wijzen op de nauwkeurigheid van RFusion. Zo blijkt uit een demonstratie van de robot objecten met een nauwkeurigheid op centimeterniveau kan lokaliseren. Volledig bedekte objecten kan de robot met een succesratio van 96% oppakken. Ook indien zij zich onder een stapel andere objecten bevinden.

“Het systeem maakt de weg vrij voor vernieuwende oppaktaken voor robots in complexe omgevingen zoals magazijnen, productielocaties en slimme woningen”, schrijven de MIT-onderzoekers in een paper.

Meer informatie is beschikbaar in de onderzoekspaper.

Auteur: Wouter Hoeffnagel

Afbeelding: Screenshot van YouTube-video

Meer nieuws

Echo met dubbele echokop verbetert beeldkwaliteit

(productnews)

Medisch & Zorg / 08-04-2025

Lees meerBoomhut opnieuw uitgevonden

(productnews)

Bouw & Constructie / 08-04-2025

Lees meerPlannen voor hoogste houten wolkenkrabber

(productnews)

Bouw & Constructie / 07-04-2025

Lees meerNederland scoort hoog op innovatieranglijst van het EOB